上一篇

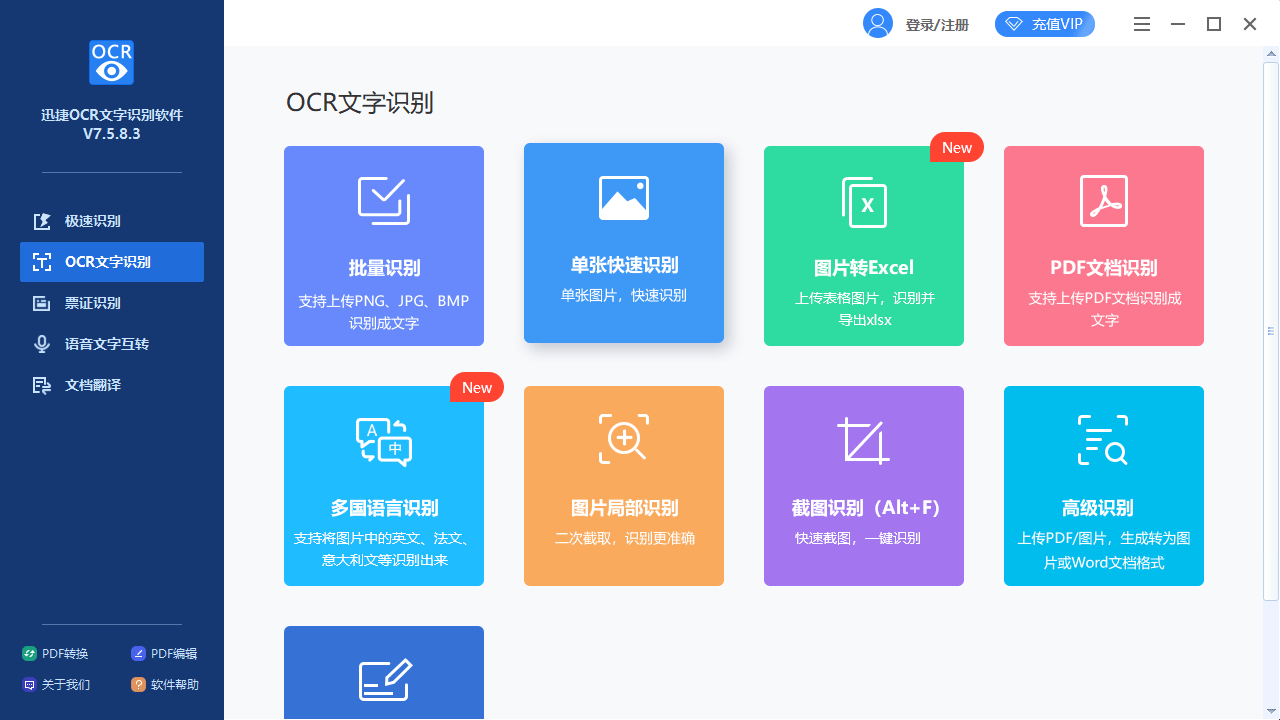

按键后台识别文字

- 行业动态

- 2025-05-14

- 3

按键后台通过OCR技术实时识别文字,精准转化输入内容,支持多语言即时交互处理

按键后台识别文字实现原理

后台按键识别文字通常结合自动化操作与光学字符识别(OCR)技术,通过模拟按键触发界面更新,截取屏幕图像并提取文字,核心流程包括:

- 按键模拟:通过代码控制键盘输入,触发目标程序界面刷新。

- 屏幕捕获:截取当前界面图像,定位文字区域。

- OCR识别:对截取的图像进行文字解析,输出文本内容。

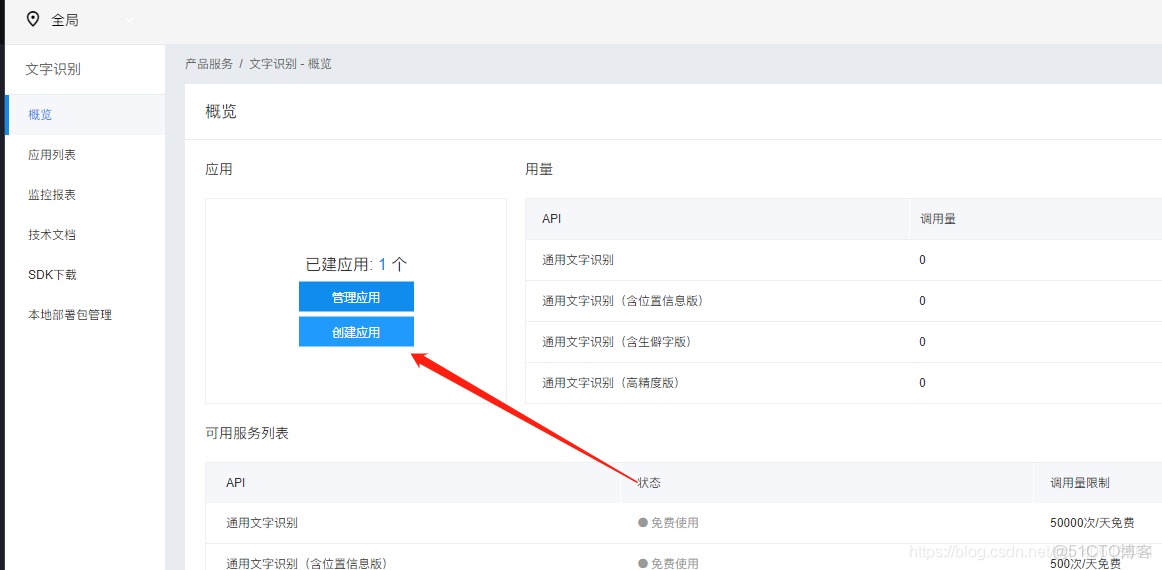

工具与环境准备

| 工具/库 | 用途 |

|---|---|

pyautogui | 模拟鼠标、键盘操作,触发界面更新 |

Pillow | 图像处理(裁剪、缩放、格式转换) |

pytesseract | 调用Tesseract引擎进行OCR文字识别 |

Tesseract-OCR | 开源OCR引擎,需单独安装 |

time | 控制操作间隔,确保界面加载完成 |

环境配置步骤:

- 安装Python及依赖库:

pip install pyautogui pillow pytesseract

- 安装Tesseract-OCR:

- Windows:下载安装包并配置环境变量。

- macOS:

brew install tesseract。 - Linux:

sudo apt install tesseract-ocr。

实现步骤与代码示例

模拟按键触发界面更新

import pyautogui

import time

# 激活目标窗口(例如记事本)

pyautogui.hotkey('alt', 'tab') # 切换窗口

time.sleep(0.5) # 等待窗口响应

pyautogui.write(['n', 'h', 'i']) # 输入测试文本

pyautogui.press('enter') # 确认输入截取屏幕并提取文字区域

from PIL import ImageGrab

import pytesseract

# 截取全屏(可调整区域)

screenshot = ImageGrab.grab()

# 保存图像(调试用)

screenshot.save('screenshot.png')

# OCR识别(指定语言为中文)

text = pytesseract.image_to_string(screenshot, lang='chi_sim')

print("识别结果:", text)整合流程(完整示例)

import pyautogui

import time

from PIL import ImageGrab

import pytesseract

# 步骤1:模拟按键输入

pyautogui.hotkey('win', 'r') # 打开运行框

pyautogui.write('notepad') # 输入记事本命令

pyautogui.press('enter') # 执行命令

time.sleep(1) # 等待窗口加载

pyautogui.write(['测', '试', '文', '字']) # 输入测试内容

pyautogui.press('f5') # 触发保存(示例快捷键)

# 步骤2:截屏并识别文字

time.sleep(0.5) # 等待界面更新

screenshot = ImageGrab.grab()

text = pytesseract.image_to_string(screenshot, lang='chi_sim')

print("识别结果:", text)注意事项

- 权限问题:部分系统需以管理员权限运行脚本,确保能模拟按键和截屏。

- 界面兼容性:目标程序需支持快捷键操作,且界面元素稳定(如固定位置)。

- OCR准确率:

- 复杂背景需预处理图像(灰度化、二值化)。

- 若文字模糊,可调整

pytesseract参数(如config='--psm 6')。

- 延时控制:

time.sleep()时间需根据设备性能调整,避免操作过快导致识别失败。

应用场景

| 场景 | 说明 |

|---|---|

| 自动化测试 | 模拟用户操作后验证界面文字是否符合预期。 |

| 游戏辅助脚本 | 提取游戏内动态文字(如聊天记录、任务提示)。 |

| 远程监控 | 定时截取后台日志界面并解析关键信息。 |

相关问题与解答

问题1:如何处理复杂背景的文字识别?

解答:

- 使用

Pillow对图像预处理:image = screenshot.convert('L') # 转灰度图 image = image.point(lambda x: 0 if x < 140 else 255, '1') # 二值化 - 调整Tesseract配置,启用自适应阈值:

text = pytesseract.image_to_string(image, config='--oem 3 --psm 6')

问题2:如何提高后台识别的成功率?

解答:

- 增加稳定性:在关键操作后添加

time.sleep(1),确保界面完全加载。 - 区域截取:仅截取文字所在区域(如

ImageGrab.grab(bbox=(x, y, w, h))),减少干扰。 - 异常重试:若识别结果为空,可循环尝试3次:

for _ in range(3): text = pytesseract.image_to_string(screenshot) if text.strip(): break