上一篇

分布式存储系统技术

- 行业动态

- 2025-05-13

- 1

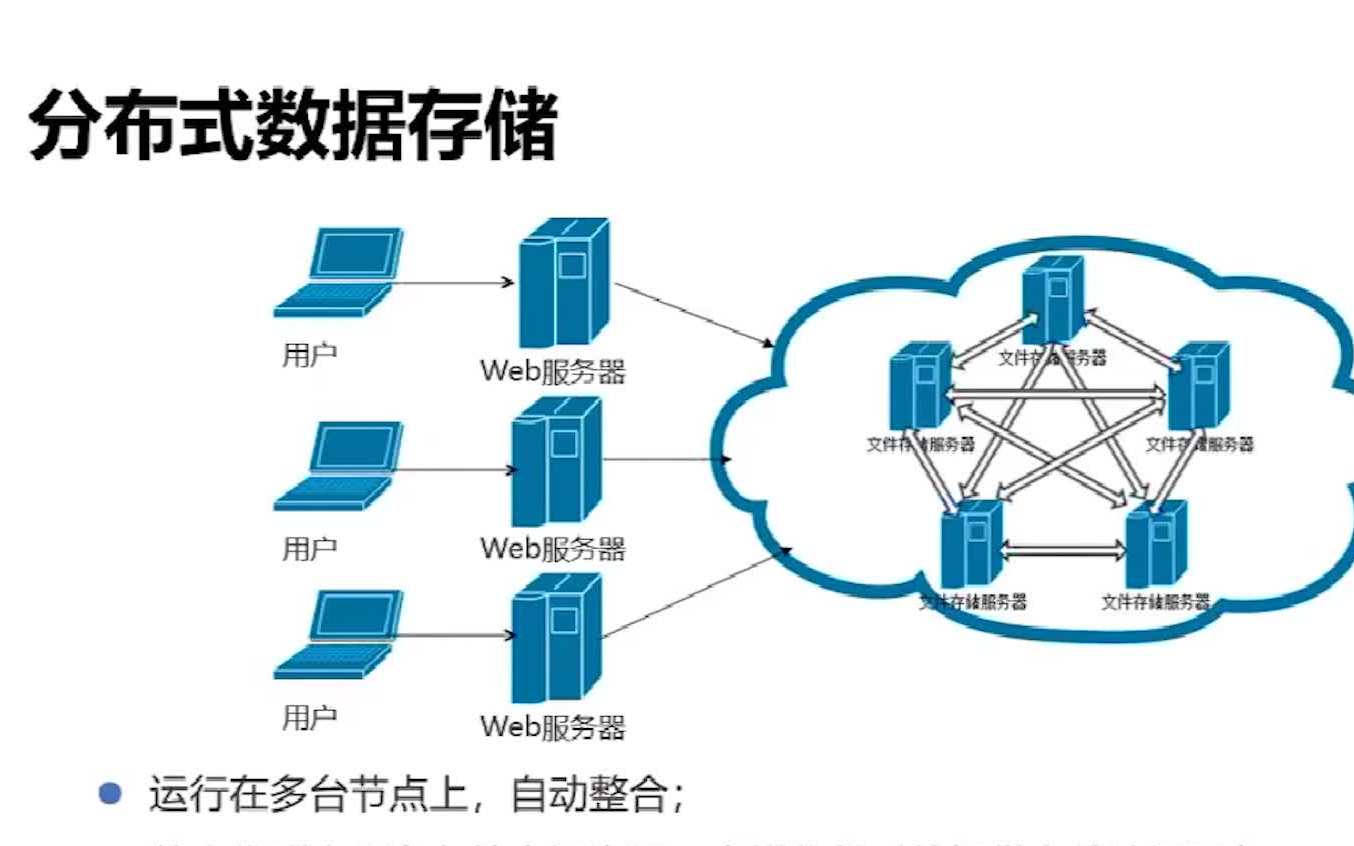

分布式存储通过数据分片与冗余备份保障高可用,具备弹性扩展、容错性强等优势,适用于

核心原理与关键技术

数据分片与分布

分布式存储的核心是将数据拆分为多个片段(Shard),分散存储在不同节点上,常见的分片方式包括:

- 哈希分片:根据数据键的哈希值分配存储节点,适用于随机访问场景。

- 范围分片:按数据范围划分片段,适合时间序列或有序数据。

- 一致性哈希:解决节点动态增减导致的分片失衡问题,提升扩展性。

数据冗余与容错

为保证数据可靠性,需通过冗余机制应对节点故障:

| 冗余策略 | 特点 | 适用场景 |

|—————-|—————————————————–|————————|

| 副本机制 | 同步复制多份数据到不同节点 | 低延迟、高可用场景 |

| 纠删码(Erasure Coding) | 将数据编码为多个块和校验块,节省存储空间 | 大容量、冷数据存储 |

| 混合模式 | 结合副本与纠删码(如Ceph) | 平衡性能与空间效率 |

一致性模型

分布式系统中需权衡一致性、可用性和分区容忍性(CAP定理):

- 强一致性:通过Paxos/Raft协议保证数据更新后所有副本一致(如ZooKeeper)。

- 最终一致性:允许短期不一致,通过版本控制或冲突解决机制(如DynamoDB)。

- 因果一致性:保证操作顺序一致,适用于日志类应用。

典型架构与技术实现

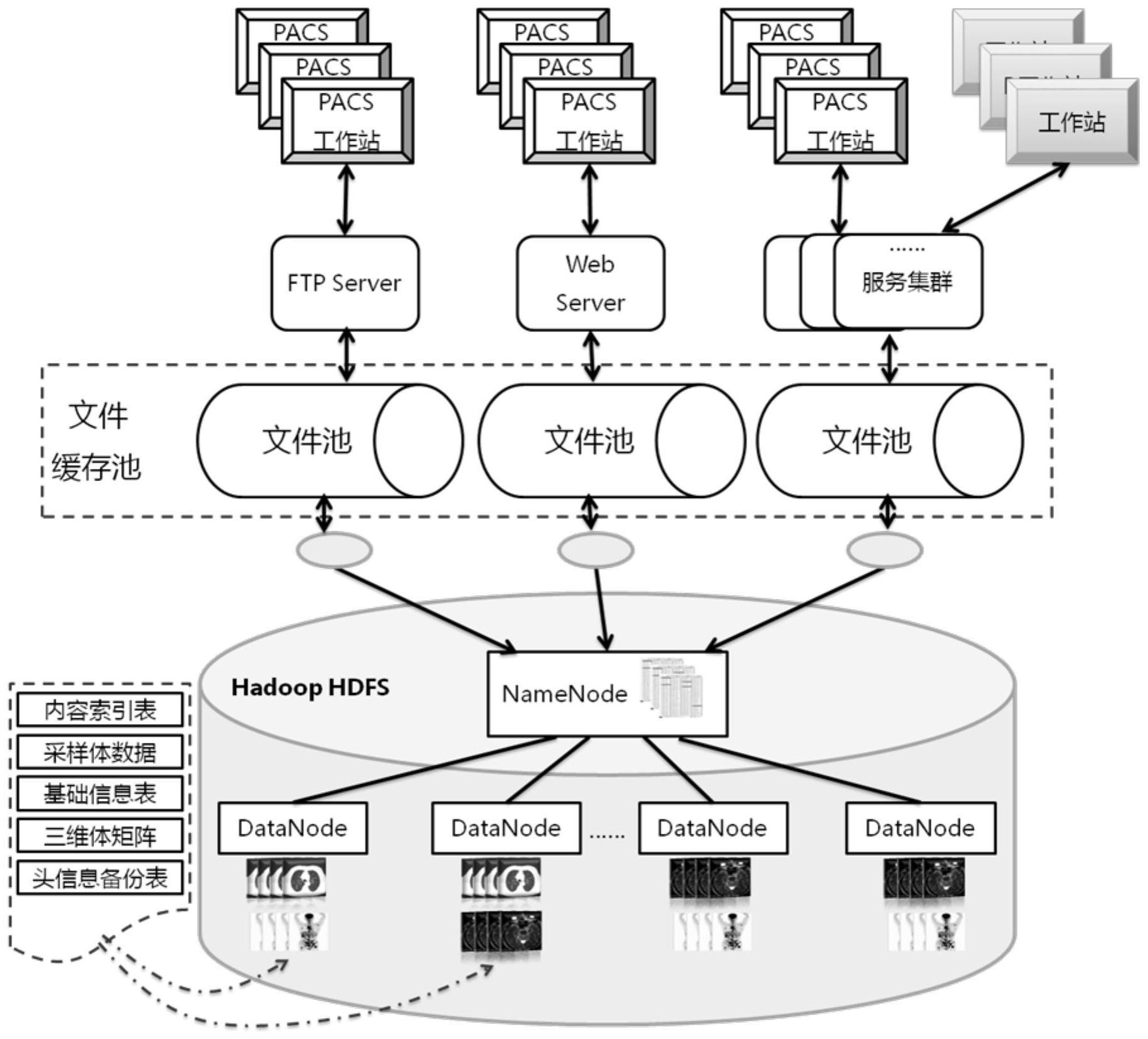

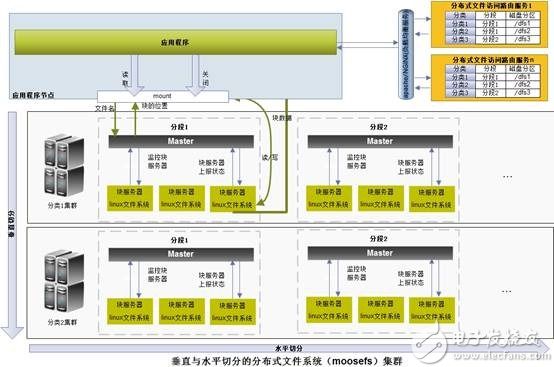

分布式文件系统(DFS)

- 代表系统:HDFS(Hadoop)、Ceph、GlusterFS。

- 特点:

- 将文件拆分为Block分布存储,支持横向扩展。

- 通过NameNode(HDFS)或MON(Ceph)管理元数据。

- 数据自动平衡与故障恢复机制。

块存储与对象存储

| 存储类型 | 典型协议 | 适用场景 | 技术代表 |

|---|---|---|---|

| 块存储 | iSCSI/FC | 高性能数据库、虚拟机磁盘 | Open-EBS、Sheepdog |

| 对象存储 | S3/Swift | 海量非结构化数据(图片、视频) | MinIO、Riak |

| 文件存储 | NFS/CIFS | 共享文件系统 | GlusterFS、MooseFS |

元数据管理

- 集中式元数据:单一节点管理(如HDFS NameNode),存在单点故障风险。

- 分布式元数据:通过Raft协议实现元数据副本同步(如Ceph MON集群)。

- 无元数据设计:对象存储(如S3)采用扁平化结构,依赖客户端拼接路径。

关键技术挑战与解决方案

数据一致性与分区容忍

- 问题:网络分区导致节点间数据不同步。

- 方案:

- 使用Raft/Paxos协议选举主节点协调更新。

- 引入版本向量(Vector Clocks)解决冲突。

负载均衡与扩展性

- 动态扩容:通过一致性哈希减少数据迁移量。

- 负载均衡:基于节点性能(CPU、带宽)动态分配数据。

故障检测与恢复

- 心跳机制:定期检测节点状态,快速触发数据重建。

- 多副本策略:结合副本与纠删码(如Ceph CRUSH算法)。

应用场景与案例

| 场景 | 需求特点 | 推荐技术 |

|---|---|---|

| 大数据分析 | 高吞吐量、低延迟 | HDFS + Alluxio |

| 云存储服务 | 弹性扩展、低成本 | MinIO + 纠删码 |

| 视频监控归档 | 冷数据长期保存 | Ceph + 对象存储 |

| 容器持久化存储 | 低延迟、高IOPS | Rook + Kubernetes |

案例:Netflix使用AWS S3作为对象存储后端,结合Timberlake工具优化数据分片策略,支撑全球流媒体服务。

未来发展趋势

- 存算一体化:存储节点集成计算能力(如SmartNIC),减少数据传输延迟。

- AI驱动优化:通过机器学习预测负载,动态调整数据分布。

- 混合云存储:跨私有云与公有云的统一存储池(如S3兼容接口)。

- 量子存储探索:利用量子纠错码提升存储密度与可靠性。

FAQs

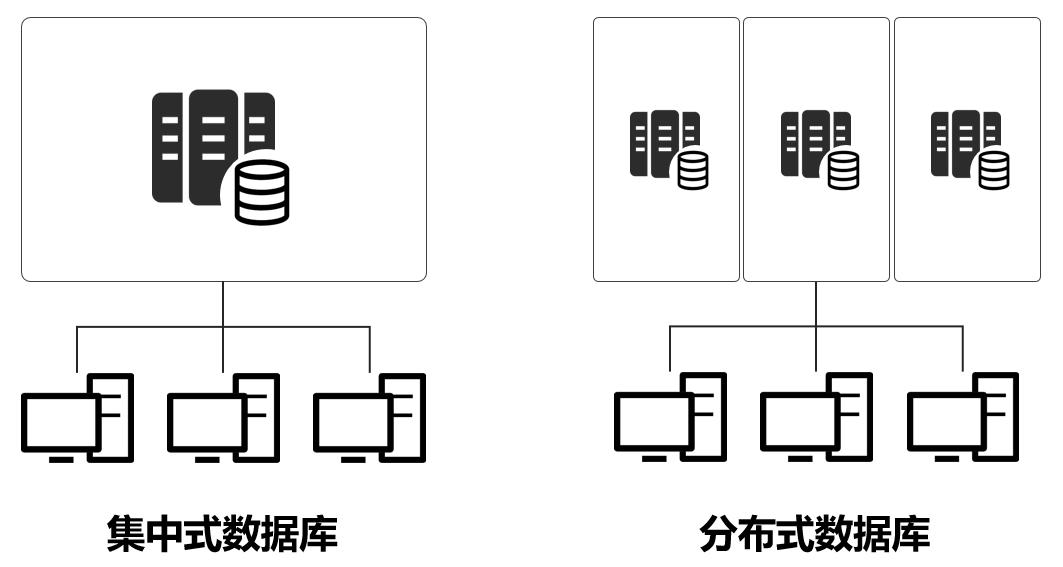

Q1:分布式存储系统与集中式存储的核心区别是什么?

A1:集中式存储依赖单一节点管理数据,存在性能瓶颈和单点故障风险;分布式存储通过多节点协作实现数据分片、冗余和负载均衡,具备高可用、高扩展性,但设计复杂度更高。

Q2:如何选择合适的数据冗余策略?

A2:若追求低延迟和简单实现,优先选择副本机制(如3副本);若存储空间敏感且数据读频繁,可采用纠删码(如RS-6编码,6块数据+3块校验),混合策略(如Ceph)可兼顾两者