上一篇

安卓图像识别和抠像技术

- 行业动态

- 2025-04-23

- 4483

安卓图像识别依托ML Kit等框架,通过神经网络分析图像特征;抠像技术采用算法分割前景与背景,结合OpenCV或深度学习模型实现精准提取,广泛应用于AR、影像编辑等

安卓图像识别与抠像技术解析

技术

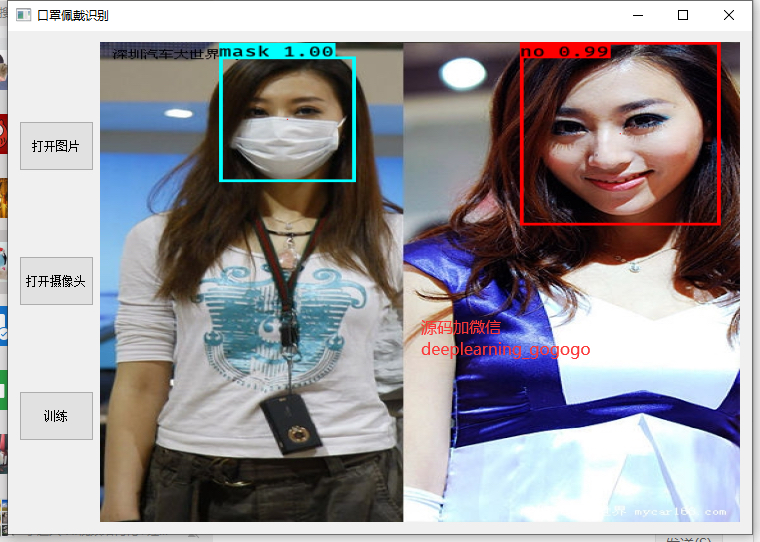

图像识别

- 定义:通过算法识别图像中的目标物体(如人脸、物体、场景等),并输出分类或定位结果。

- 应用场景:人脸识别解锁、物体分类、场景识别等。

- 技术分支:

- 传统方法:基于特征提取(如SIFT、SURF)或机器学习(如SVM)。

- 深度学习方法:基于CNN(如MobileNet、YOLO)、Transformer(如ViT)。

图像抠像

- 定义:将图像中的主体(如人、物体)从背景中分离出来,生成透明背景的图层。

- 应用场景:人像抠图、虚拟背景替换、AR合成等。

- 技术分支:

- 传统方法:基于颜色阈值、边缘检测(如GrabCut算法)。

- 深度学习方法:基于语义分割(如U²-Net、DeepLabv3+)。

核心技术对比

| 技术类型 | 图像识别 | 图像抠像 |

|---|---|---|

| 传统方法 | SIFT、HOG、SVM | GrabCut、K-means聚类 |

| 深度学习方法 | MobileNet、YOLO、EfficientNet | U²-Net、DeepLabv3+、Mask R-CNN |

| 模型特点 | 轻量级、高速度、低精度 | 高精度、复杂计算、需后处理 |

| 适用场景 | 实时性要求高的场景 | 对边缘细节要求高的抠图任务 |

安卓平台实现流程

图像识别流程

- 步骤1:数据采集

- 通过摄像头(

CameraXAPI)或本地相册获取图像。

- 通过摄像头(

- 步骤2:模型加载

- 使用

TensorFlow Lite或ML Kit加载预训练模型(如MobileNet)。

- 使用

- 步骤3:推理与输出

输入图像至模型,获取分类或边界框结果。

- 步骤4:结果展示

- 在

Canvas或ImageView上绘制识别框或分类标签。

- 在

- 步骤1:数据采集

图像抠像流程

- 步骤1:前景分割

- 使用

U²-Net或DeepLabv3+模型生成前景掩码(Mask)。

- 使用

- 步骤2:背景替换

根据掩码提取前景,合成新背景(如纯色或另一张图像)。

- 步骤3:边缘优化

- 通过

羽化(Feather)或形态学操作平滑边缘。

- 通过

- 步骤1:前景分割

常用工具与框架

| 工具/框架 | 适用场景 | 特点 |

|---|---|---|

| TensorFlow Lite | 自定义模型部署 | 支持多种模型格式(.tflite),需手动优化模型大小和速度。 |

| ML Kit | 快速集成基础功能 | 提供预训练模型(如人脸检测、条码扫描),无需复杂配置。 |

| OpenCV | 传统图像处理 | 适合基础特征提取、滤波、边缘检测,但需手动实现深度学习模型。 |

| MediaPipe | 高效人体姿态与手部识别 | 专为实时性设计,支持多任务(如人脸、肢体、虹膜识别)。 |

性能优化策略

- 模型压缩

- 量化(Quantization):将浮点模型转为整数(如

INT8),减少计算量。 - 剪枝(Pruning):移除冗余参数,缩小模型体积。

- 量化(Quantization):将浮点模型转为整数(如

- 硬件加速

- 利用

GPU(如OpenGL)或NNAPI加速推理过程。

- 利用

- 异步处理

- 使用

Kotlin Coroutine或ExecutorService避免主线程阻塞。

- 使用

- 内存管理

- 复用

Bitmap对象,避免频繁创建/回收内存。

- 复用

相关问题与解答

问题1:如何选择图像识别模型?

- 解答:

- 优先ML Kit:若需求简单(如人脸检测、条码扫描),直接使用ML Kit预训练模型,节省开发时间。

- 自定义模型:若需特殊场景(如特定物体识别),选择轻量级模型(如MobileNetV3),并通过

TensorFlow Lite转换和量化优化。 - 平衡精度与速度:移动端需权衡模型复杂度,建议使用

TFLite Model Zoo中的预训练模型。

问题2:抠像时如何提升边缘质量?

- 解答:

- 后处理优化:

- 对生成的掩码进行

高斯模糊或膨胀/腐蚀操作,消除锯齿。 - 使用

Alpha通道混合技术,让边缘过渡更自然。

- 对生成的掩码进行

- 模型选择:

- 优先选择基于

U-Net架构的模型(如U²-Net),其对细粒度边缘更敏感。

- 优先选择基于

- 数据增强:

训练时加入边缘模糊、噪声干扰的数据,提升模型鲁棒性。

- 后处理优化: