上一篇

安卓图像识别开发包

- 行业动态

- 2025-04-23

- 3954

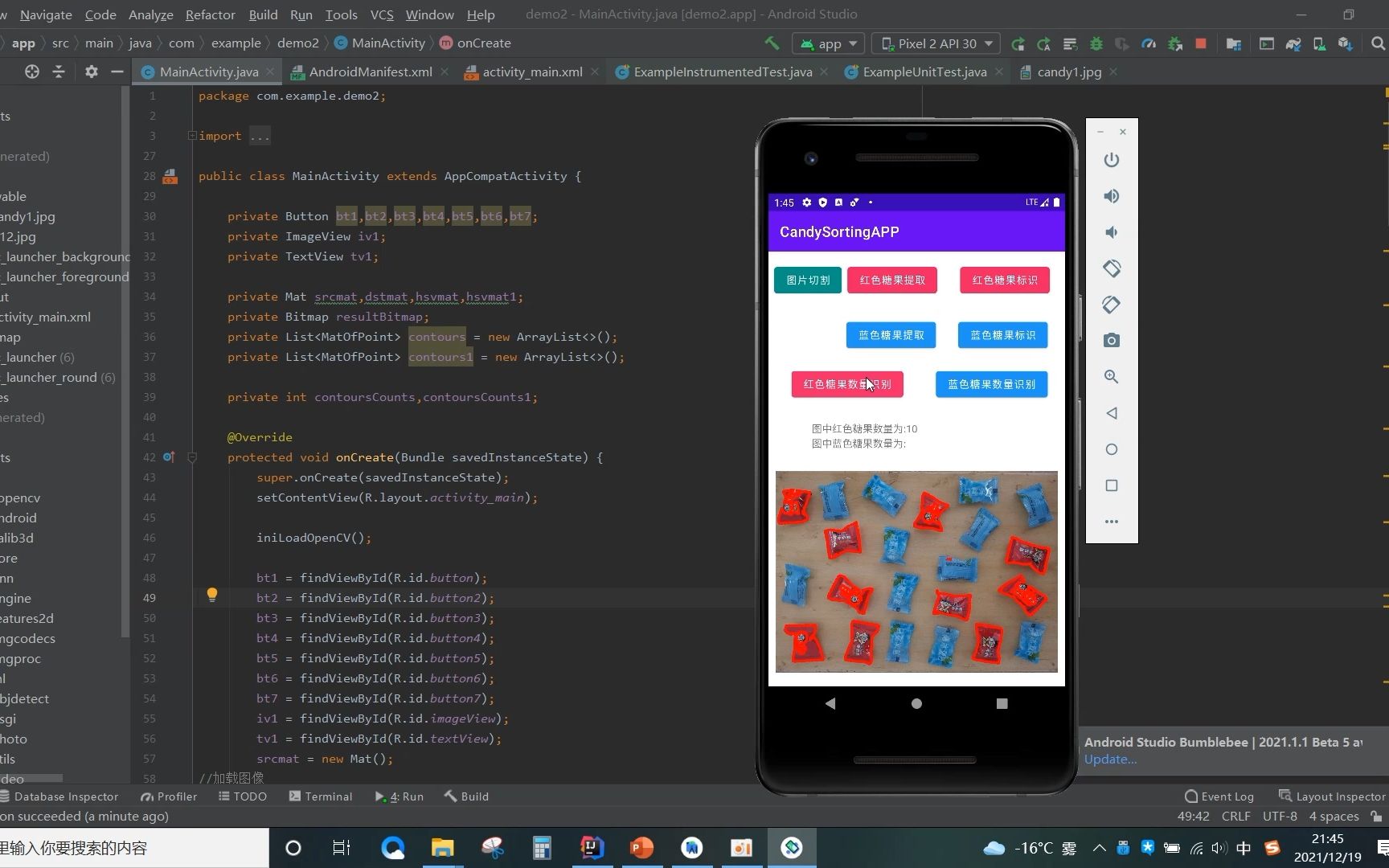

安卓图像识别常用开发包包括TensorFlow Lite(轻量模型部署)、OpenCV(传统图像处理)、ML Kit(谷歌机器学习API),支持移动端优化与实时识别场景

主流安卓图像识别开发包对比

| 开发包 | 核心功能 | 模型支持 | 依赖环境 | 适用场景 |

|---|---|---|---|---|

| TensorFlow Lite | 轻量级模型推理、模型量化 | TensorFlow模型(.pb/.tflite) | Android NNAPI/GPU/CPU | 离线推理、高性能需求 |

| ML Kit (Firebase) | 预训练模型(人脸、物体、文本等) | 自定义TF Lite模型 | Firebase依赖 | 快速集成、云端辅助 |

| OpenCV | 图像处理、特征提取、传统算法 | 无预设模型(需自建) | OpenCV原生库 | 自定义算法、复杂图像处理 |

| Core ML (via TF Lite) | 苹果设备兼容(需转换模型) | Core ML模型(.mlmodelc) | iOS/macOS | 跨平台开发(需额外适配) |

| PaddleLite | 百度飞桨模型推理、量化压缩 | PaddleHub模型(.pdmodel) | Android NNAPI/GPU/CPU | 中文场景、Paddle生态集成 |

开发包选择建议

- 快速集成:选ML Kit(Firebase),提供现成API,适合基础需求(如人脸检测、条形码扫描)。

- 高性能离线推理:选TensorFlow Lite,支持模型量化、硬件加速,适合复杂模型。

- 自定义算法:选OpenCV,需自行实现图像处理逻辑,适合传统计算机视觉任务。

- 中文场景:选PaddleLite,兼容百度飞桨生态,中文NLP/图像模型丰富。

实现步骤(以TensorFlow Lite为例)

环境配置

- 添加依赖:

implementation 'org.tensorflow:tensorflow-lite:2.9.0'

- 模型转换:将TensorFlow模型转换为

.tflite格式(使用tf.lite.TFLiteConverter)。

- 添加依赖:

模型加载与推理

// 加载模型 MappedByteBuffer model = FileUtil.loadMappedFile(context, "model.tflite"); Interpreter interpreter = new Interpreter(model); // 输入预处理 Bitmap bitmap = ... // 获取输入图像 ByteBuffer input = ByteBuffer.allocateDirect(1 224 224 3 4); // 图像缩放、归一化等操作 // 执行推理 float[][] output = new float[1][10]; // 假设输出为10类概率 interpreter.run(input, output);

结果解析

- 解析

output数组,获取分类结果或检测框坐标。

- 解析

性能优化技巧

| 优化方向 | 方法 |

|---|---|

| 模型压缩 | 量化(INT8)、剪枝、知识蒸馏 |

| 硬件加速 | 启用GPU/NNAPI(需Android 8.0+) |

| 内存管理 | 复用输入/输出缓冲区,避免频繁分配 |

| 异步处理 | 使用ExecutorService或AsyncTask防止阻塞主线程 |

常见问题与解决

问题1:TensorFlow Lite模型转换后精度下降

原因:量化导致权重精度损失,或输入预处理不一致。

解决:

- 使用

float32模式调试,确认模型本身精度。 - 检查输入图像的归一化参数(如均值、标准差)。

- 尝试PTQ(后训练量化)或全整数量化。

问题2:ML Kit实时检测帧率不足

原因:模型复杂度高或设备性能不足。

解决:

- 降低输入图像分辨率(如640×480→320×240)。

- 启用

ML Kit的LiveDetection模式,自动调整帧率。 - 使用轻量模型(如MobileNet代替ResNet)。

相关问题与解答

问题1:如何将PyTorch模型部署到安卓?

解答:

- 将PyTorch模型转换为ONNX格式:

torch.onnx.export(model, dummy_input, "model.onnx")。 - 使用ONNX Runtime或TensorFlow Lite Converter将ONNX转为

.tflite。 - 在安卓项目中集成对应推理库(如ONNX Runtime Mobile)。

问题2:ML Kit是否支持离线人脸识别?

解答:

- ML Kit的

FaceDetector支持离线,但需下载预训练模型至本地。 - 若需自定义模型,需通过

Firebase ML Models上传TF Lite模型,并在安卓端