上一篇

如何挑选高性能的英伟达GPU云服务器?

- 行业动态

- 2025-04-29

- 3754

英伟达GPU云服务器是基于NVIDIA高性能显卡构建的云计算服务,提供强大的并行计算能力,适用于深度学习训练、AI推理、科学模拟等场景,其搭载的Tesla/V100/A100等专业级GPU支持CUDA加速,兼容TensorFlow、PyTorch等主流框架,具备弹性扩展和按需付费特性,可显著降低企业算力成本,满足科研机构、互联网公司及开发者的高性能计算需求。

在云计算与人工智能高速发展的今天,GPU云服务器正成为企业数字化转型的核心基础设施,作为全球GPU技术的领航者,英伟达(NVIDIA)凭借其硬件架构创新、软件生态完整性与行业解决方案成熟度,为云服务市场注入了强劲动力,以下从技术原理、应用场景到选型建议,全方位解析英伟达GPU云服务器的核心价值。

为什么选择英伟达GPU云服务器?

硬件性能的绝对优势

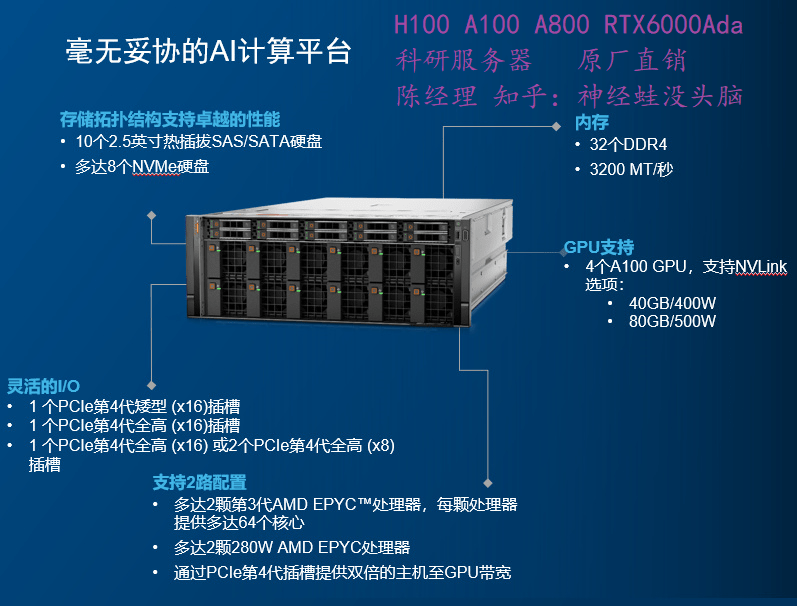

- Ampere与Hopper架构:基于NVIDIA Ampere架构的A100/A40 GPU,以及新一代Hopper架构的H100 GPU,采用多实例GPU(MIG)技术,可将单个物理GPU分割为7个独立实例,实现资源精细化管理。

- Tensor Core与RT Core:第四代Tensor Core支持FP64双精度计算,AI训练速度较前代提升20倍;RT Core光线追踪能力为实时渲染提供电影级画质。

- NVLink高速互联:GPU间带宽达900GB/s,突破传统PCIe 4.0的64GB/s瓶颈,支持多卡协同计算。

软件生态的全栈覆盖

- CUDA并行计算平台:超过200万个开发者使用的行业标准,覆盖机器学习框架(TensorFlow、PyTorch)、科学计算(MATLAB)等场景。

- NGC(NVIDIA GPU Cloud):提供预优化的AI模型、HPC应用容器与SDK工具包,部署时间缩短70%。

- DOCA软件框架:专为数据中心设计的开发环境,实现网络、存储与安全功能的硬件加速。

行业权威认证与合规性

- 通过ISO 27001信息安全管理体系认证,满足金融、医疗等敏感行业的合规需求。

- 获得MLPerf基准测试多项冠军,AI训练与推理性能获国际权威背书。

典型应用场景与解决方案

人工智能开发

- 大规模模型训练:单台配备8颗A100的云服务器可支持千亿参数模型训练,例如GPT-3的1750亿参数训练周期缩短至1个月。

- 边缘AI推理:T4 GPU凭借70W超低功耗与INT8量化技术,在视频分析场景实现2000帧/秒处理能力。

高性能计算(HPC)

- 基因测序:采用CUDA加速的GROMACS分子动力学软件,运算速度较CPU集群提升10倍。

- 气候模拟:欧洲中期天气预报中心(ECMWF)使用英伟达GPU将气象预测分辨率提升至1公里级。

图形可视化与元宇宙

- 云游戏:GeForce RTX 4080云GPU支持4K/120Hz光追渲染,延迟低于20ms。

- 数字孪生:Omniverse平台通过USD通用场景描述,实现工业仿真场景的实时协作。

主流云厂商英伟达GPU机型对比

| 云服务商 | 实例类型 | GPU型号 | 显存容量 | 适用场景 |

|---|---|---|---|---|

| 阿里云 | gn7i | A10 | 24GB | 图形渲染、轻量级AI推理 |

| 酷盾 | GN10X | A100 | 40GB | 大规模模型训练 |

| AWS | p4d.24xlarge | A100 | 80GB | 高性能计算集群 |

| 华为云 | Pi1 | V100 | 32GB | 中等规模深度学习 |

选型决策关键指标

计算密度需求

- FP16算力:A100达312 TFLOPS,T4为65 TFLOPS

- 根据模型参数量选择卡数(10亿参数模型建议≥4颗A100)

显存带宽匹配

- HBM2e显存(A100:1.6TB/s)适合高吞吐任务

- GDDR6(T4:320GB/s)满足常规推理需求

TCO(总拥有成本)优化

- 采用竞价实例处理批量推理任务可降低成本60%

- 弹性伸缩策略实现资源利用率最大化

部署与运维建议

- 混合云架构:核心训练集群采用私有云+敏感数据本地化,推理服务部署公有云实现弹性扩展。

- 监控工具:通过NVIDIA DCGM实时监控GPU利用率、温度与ECC错误率。

- 能效管理:启用MIG技术将闲置GPU切片,降低单位任务功耗。

通过上述分析可见,英伟达GPU云服务器不仅代表着计算硬件的巅峰性能,更构建了覆盖开发、部署到运维的全生命周期服务体系,无论是初创企业的敏捷创新,还是科研机构的超算需求,均可通过按需付费的云服务模式获得顶级算力支持。

参考文献:

[1] NVIDIA官方技术白皮书《Ampere Architecture In-Depth》

[2] MLPerf联盟2025年基准测试报告

[3] IDC《2025全球人工智能基础设施市场预测》

[4] 阿里云GPU云服务器产品文档

[5] AWS EC2实例类型技术规格