上一篇

bp 网络的

- 行业动态

- 2025-04-10

- 1

BP网络:原理、训练与应用全解析

在人工智能与机器学习领域,BP网络(反向传播神经网络)是监督学习中最经典的算法之一,它以强大的模式识别能力和非线性拟合特性,广泛应用于图像处理、语音识别、金融预测等领域,本文将深入剖析BP网络的原理、训练过程及实际应用,帮助读者全面理解这一算法的核心价值。

BP网络的定义与背景

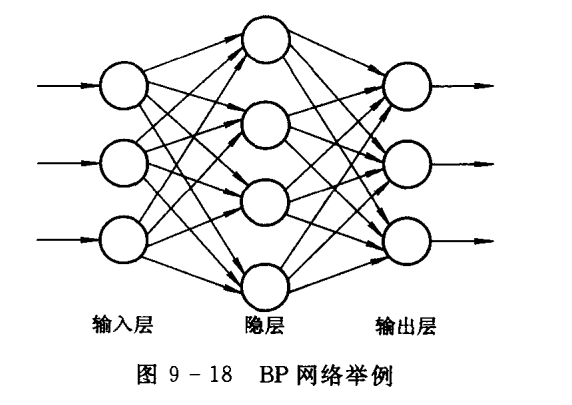

BP(Back Propagation)神经网络是一种基于误差反向传播算法训练的多层前馈神经网络,由Rumelhart、Hinton和Williams于1986年首次提出,它的核心思想是通过梯度下降法调整网络权重,使得模型的输出误差最小化,BP网络属于人工神经网络的典型结构,包含输入层、隐藏层和输出层,每一层由多个神经元(节点)组成,通过激活函数实现非线性映射。

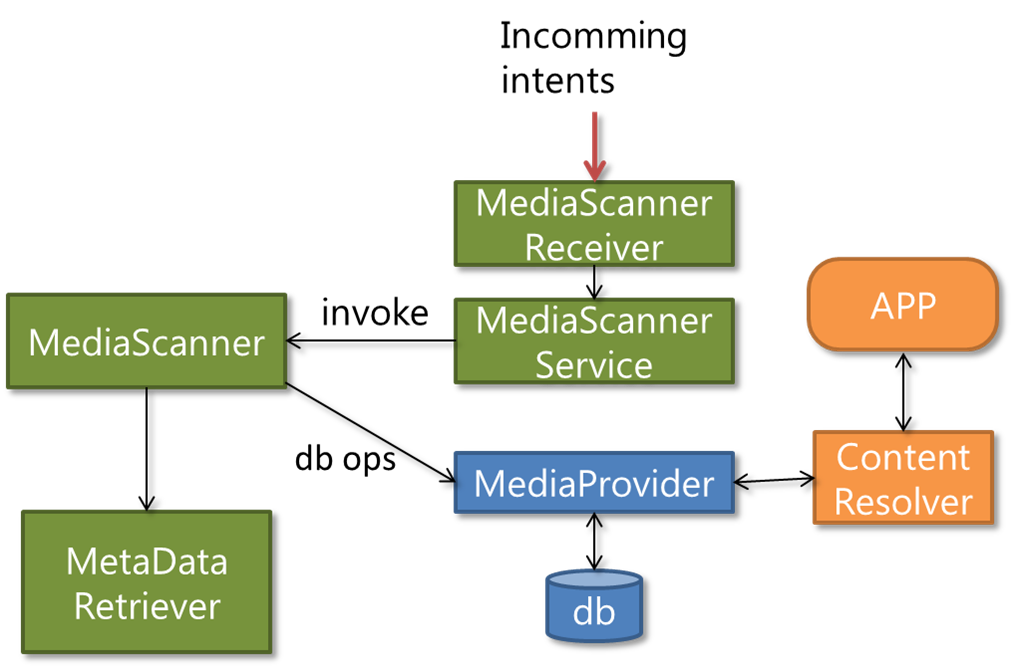

BP网络的结构与工作原理

网络结构

- 输入层:接收外部数据,节点数量与特征维度一致。

- 隐藏层:通常为1-3层,负责提取数据的高阶特征。

- 输出层:生成最终预测结果,节点数量由任务类型决定(例如分类任务对应类别数)。

前向传播

数据从输入层逐层传递至输出层,每个神经元通过加权求和与激活函数计算输出值,常用激活函数包括Sigmoid、ReLU和Tanh。

反向传播

- 误差计算:通过损失函数(如均方误差、交叉熵)量化预测值与真实值的差距。

- 梯度回传:从输出层反向逐层计算每个权重的梯度,明确误差来源。

- 权重更新:使用优化算法(如随机梯度下降)调整权重,降低误差。

BP网络的训练过程

关键步骤

- 初始化权重:通常采用随机初始化,避免对称权重导致学习停滞。

- 迭代优化:

- 前向传播计算输出。

- 反向传播更新权重。

- 终止条件:达到预设迭代次数,或误差低于阈值。

训练优化技巧

- 学习率调整:过高的学习率可能导致震荡,过低则收敛缓慢。

- 正则化:L1/L2正则化防止过拟合。

- 批量训练:Mini-Batch梯度下降平衡计算效率与稳定性。

- 早停法(Early Stopping):验证集误差上升时提前终止训练。

BP网络的优缺点

优点

- 强大的非线性拟合能力,可解决复杂分类与回归问题。

- 理论成熟,实现简单,适合作为神经网络入门学习模型。

局限性

- 易陷入局部极小值,依赖初始权重。

- 隐藏层数过多时可能引发梯度消失/爆炸问题。

- 训练速度较慢,尤其对高维数据。

改进方案:引入动量法(Momentum)、自适应学习率(如Adam优化器)、残差连接等。

BP网络的实际应用场景

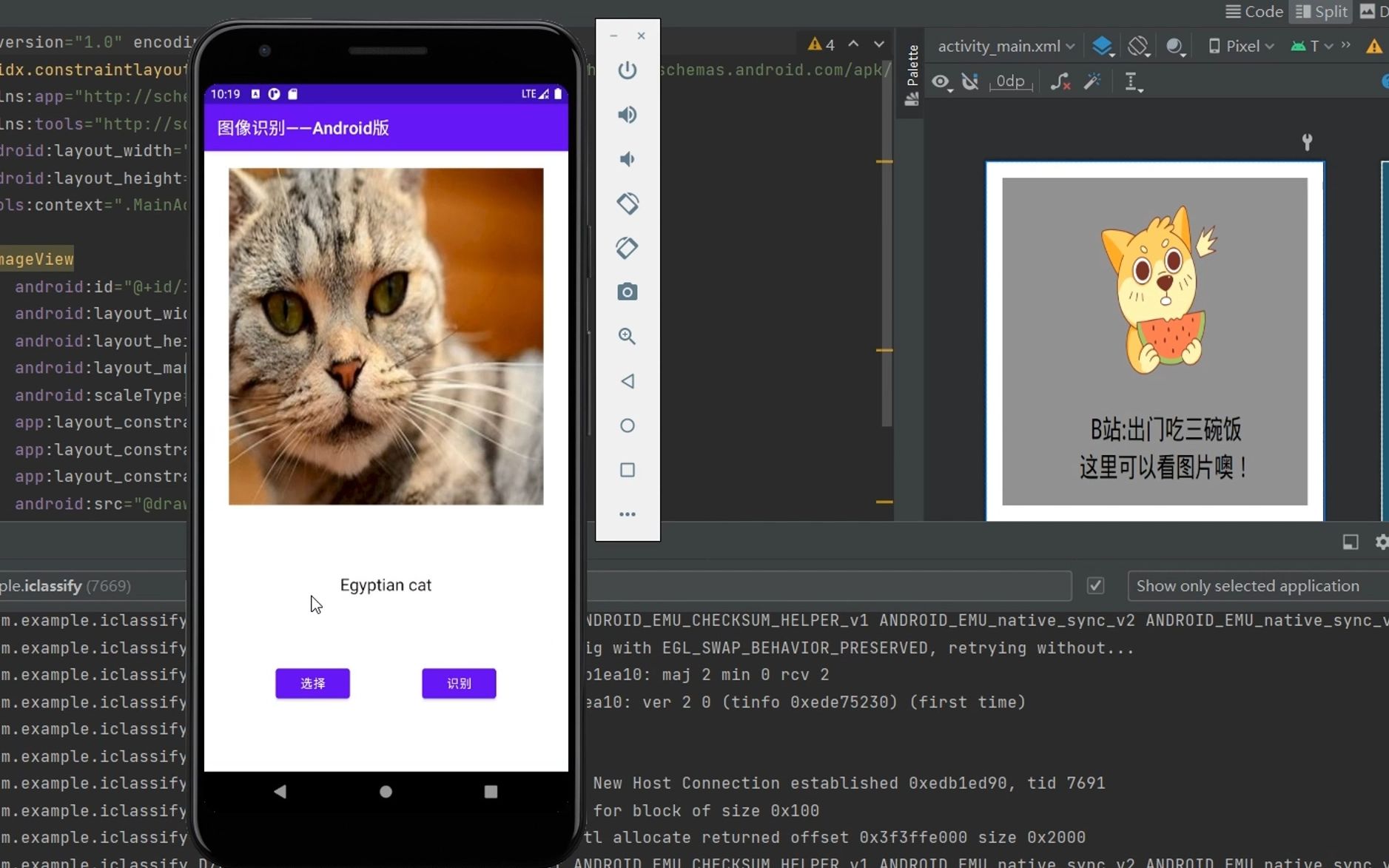

- 图像识别:手写数字识别(如经典案例LeNet-5)、人脸检测。

- 自然语言处理:文本分类、情感分析。

- 金融预测:股票价格趋势预测、信用风险评估。

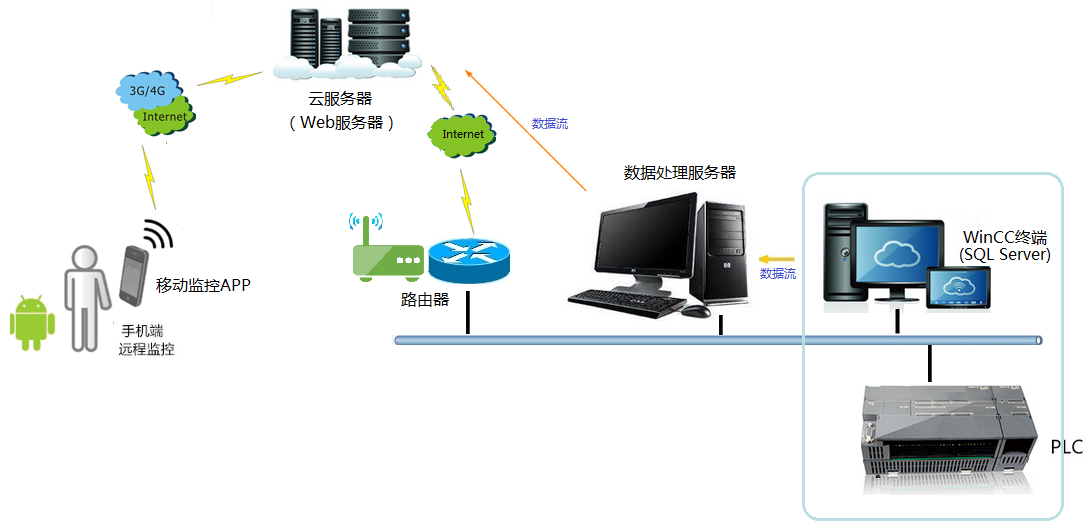

- 工业控制:故障诊断、产品质量预测。

如何学习BP网络?

- 经典教材:《模式识别与机器学习》(Christopher Bishop)、《神经网络与深度学习》(Michael Nielsen)。

- 论文推荐:Rumelhart等1986年发表的《Learning representations by back-propagating errors》。

- 实践工具:Python库(TensorFlow、PyTorch)提供BP网络的高效实现。

参考文献

- Rumelhart, D. E., Hinton, G. E., & Williams, R. J. (1986). Learning representations by back-propagating errors. Nature.

- Bishop, C. M. (2006). Pattern Recognition and Machine Learning. Springer.

- 周志华. (2016). 机器学习. 清华大学出版社.

通过本文的解析,读者不仅能掌握BP网络的核心原理,还能了解其实际应用中的关键技巧,为后续学习深度神经网络奠定坚实基础。