cuda和深度学习

- 行业动态

- 2025-02-14

- 14

CUDA与深度学习:技术融合与应用探索

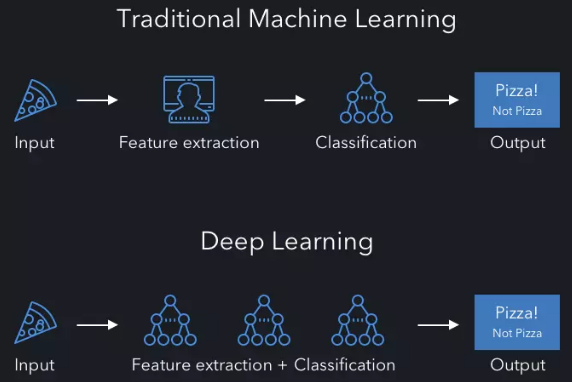

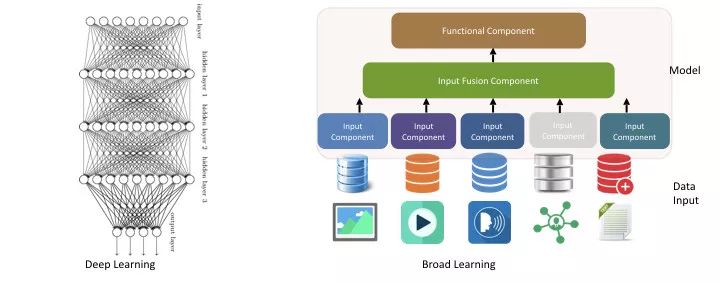

在当今人工智能飞速发展的时代,CUDA(Compute Unified Device Architecture)与深度学习的结合成为了推动技术进步的重要力量,CUDA,作为NVIDIA推出的并行计算平台和编程模型,为GPU(图形处理器)提供了强大的计算能力,而深度学习则是一种基于人工神经网络的机器学习方法,通过多层神经网络对输入数据进行逐层抽象和表示学习,从而实现对复杂数据结构和非线性关系的建模,下面将深入探讨CUDA与深度学习之间的紧密联系及其在实际应用中的表现。

一、CUDA

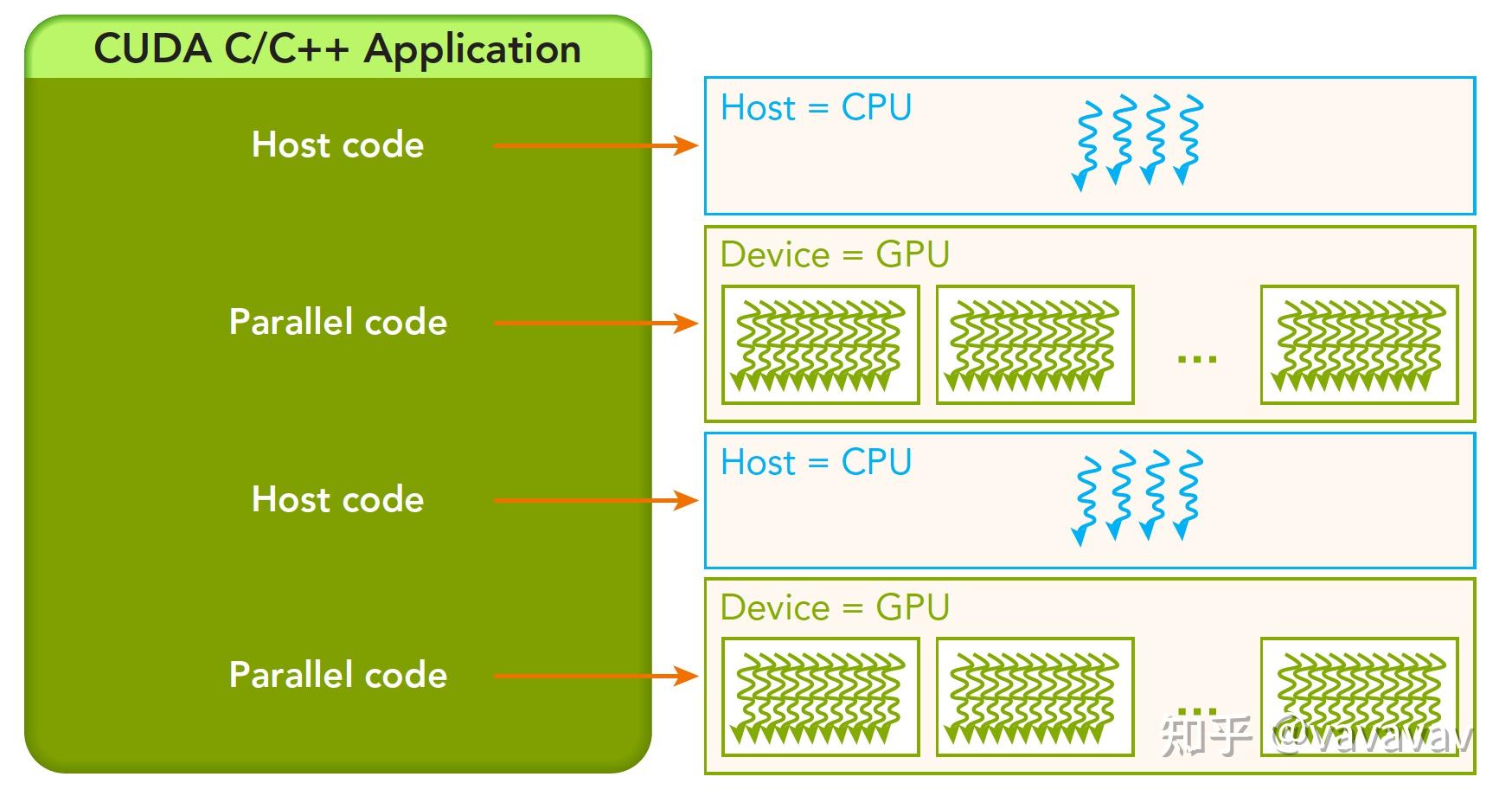

CUDA是NVIDIA于2006年推出的一种通用并行计算架构,它包含了CUDA指令集架构(ISA)以及GPU内部的并行计算引擎,通过扩展C/C++语言,CUDA允许开发者使用GPU的并行计算能力来解决复杂的计算问题,从而大幅提升计算性能,经过多年的发展,CUDA已经广泛应用于高性能计算、游戏开发、深度学习等领域,成为GPU计算的重要标准之一。

二、CUDA系统架构

CUDA的系统架构由开发库(Libraries)、运行期环境(Runtime)和驱动(Driver)三部分组成,开发库基于CUDA技术提供的应用开发库,如CUFFT和CUBLAS,用于解决大规模的并行计算问题,运行期环境提供了应用开发接口和运行期组件,包括基本数据类型的定义和各类计算、类型转换、内存管理、设备访问和执行调度等函数,驱动部分则是硬件抽象层,负责硬件资源的管理和错误处理。

三、CUDA在深度学习中的应用

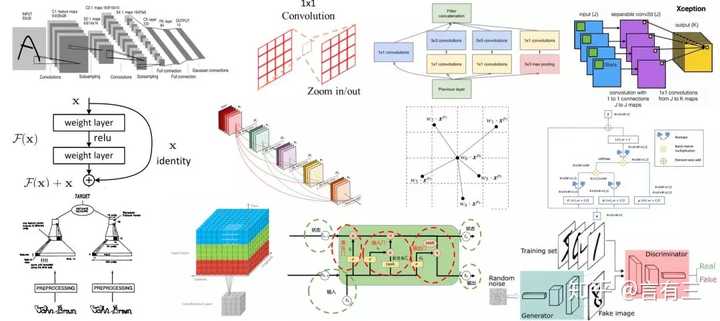

1、模型训练加速:在深度学习中,模型训练是一个计算密集型的过程,CUDA通过其强大的并行处理能力,可以显著加速模型的训练过程,在卷积神经网络(CNN)中,CUDA可以并行化卷积层的计算,从而大幅提高训练速度。

2、实时数据处理:在模型推理阶段,即利用训练好的模型进行预测时,CUDA同样发挥着重要作用,它可以加速数据的处理速度,使得模型能够快速响应,适用于需要实时反馈的应用,如自动驾驶车辆的视觉系统。

3、支持大型模型:随着深度学习模型规模的不断扩大,对计算资源的需求也日益增加,CUDA使得训练大型模型成为可能,因为它能够有效处理和存储巨大的网络权重和数据集。

4、灵活的资源管理:CUDA允许动态分配和管理GPU资源,这使得深度学习模型训练更为高效,开发者可以根据需要灵活调整GPU的使用情况,以优化计算性能。

5、高效的矩阵运算:神经网络的训练涉及大量的矩阵运算,如矩阵乘法,GPU的并行架构非常适合这种类型的计算,因此CUDA在深度学习中的矩阵运算加速方面发挥了重要作用。

四、FAQs

1、Q: CUDA与CPU在计算性能上有何差异?

A: CUDA设计的GPU在处理可以并行化的大规模数据时,表现出远超CPU的处理速度,这是因为GPU包含成百上千的小核心,每个核心专注于执行单一任务,但在并行处理大量数据时表现卓越,而CPU通常包含较少的核心,但每个核心能够处理复杂任务和多任务并发。

2、Q: CUDA如何优化显存存储以提高计算效率?

A: 在深度学习中,大量的数据需要在GPU中进行处理,CUDA提供了多种显存存储优化技术,如使用共享内存、优化内存拷贝等,以减少数据传输的开销并提高计算效率。

3、Q: CUDA是否支持多GPU系统?

A: 是的,从CUDA 4.0开始,就特别强调了对多GPU系统的支持,允许更加灵活的数据共享和任务分配,这使得在多GPU环境下进行深度学习模型的训练和推理成为可能。

五、小编有话说

随着人工智能技术的不断发展,CUDA与深度学习的结合将越来越紧密,CUDA的强大并行处理能力和灵活的资源管理特性,使得它在深度学习领域具有广泛的应用前景,我们可以期待看到更多基于CUDA的创新应用和技术突破,为人工智能的发展注入新的动力,随着技术的不断进步和应用场景的不断拓展,CUDA和深度学习也将共同推动计算极限的不断扩展。