上一篇

bp神经网络手写识别

- 行业动态

- 2025-04-10

- 3

手写识别是人工智能领域的重要应用场景之一,从银行支票处理到智能设备输入,其技术核心离不开高效的算法模型。BP神经网络(误差反向传播神经网络)作为经典的深度学习模型,因其强大的非线性拟合能力和可解释性,成为手写识别领域的基础解决方案,本文将深入解析BP神经网络在手写识别中的工作原理、实现流程与优化方向。

BP神经网络的核心原理

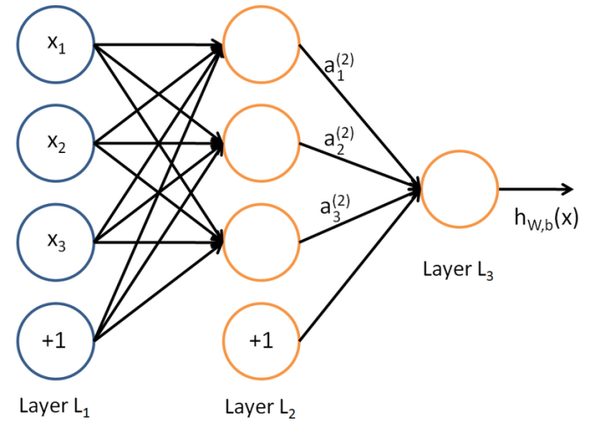

BP神经网络通过前向传播计算输出与反向传播调整参数的迭代过程实现学习,包含以下关键环节:

网络结构

- 输入层:接收手写图像的像素数据(如28×28的MNIST图像展开为784维向量)

- 隐藏层:通常1-3层,使用Sigmoid、ReLU等激活函数引入非线性

- 输出层:对应分类类别数(如数字0-9共10个神经元),采用Softmax函数输出概率分布

损失函数

交叉熵损失(Cross-Entropy Loss)衡量预测结果与真实标签的差异:

$$ L = -sum_{i=1}^{n} y_i log(p_i) $$

y_i$为真实标签,$p_i$为预测概率。

反向传播

通过链式法则逐层计算梯度,使用梯度下降法更新权重:

$$ w{new} = w{old} – eta cdot frac{partial L}{partial w} $$

($eta$为学习率)

手写识别的实现步骤

以MNIST数据集为例,完整流程如下:

| 步骤 | 操作 | 技术细节 |

|---|---|---|

| 数据预处理 | 图像归一化与标签编码 | 像素值缩放到[0,1],标签转为One-Hot编码 |

| 网络搭建 | 定义层数与神经元数量 | 输入层784节点,隐藏层128节点,输出层10节点 |

| 模型训练 | 批量训练与参数更新 | 使用Mini-Batch(如64样本/批次),学习率0.01 |

| 性能评估 | 准确率与混淆矩阵 | 计算测试集分类准确率,分析错误样本 |

代码示例(Python伪代码)

model = Sequential() model.add(Dense(128, activation='relu', input_shape=(784,))) model.add(Dense(10, activation='softmax')) model.compile(loss='categorical_crossentropy', optimizer='sgd', metrics=['accuracy']) model.fit(X_train, y_train, epochs=50, batch_size=64)

优化策略与挑战

提升识别精度的关键方法:

- 数据增强:对训练图像添加旋转、平移、噪声扰动,提高模型泛化能力

- 网络结构改进:引入卷积层(CNN)提取局部特征,参数量减少90%以上

- 正则化技术:使用Dropout(随机失活)或L2正则化防止过拟合

实际应用难点:

- 书写风格差异:连笔、倾斜、笔画粗细变化影响特征提取

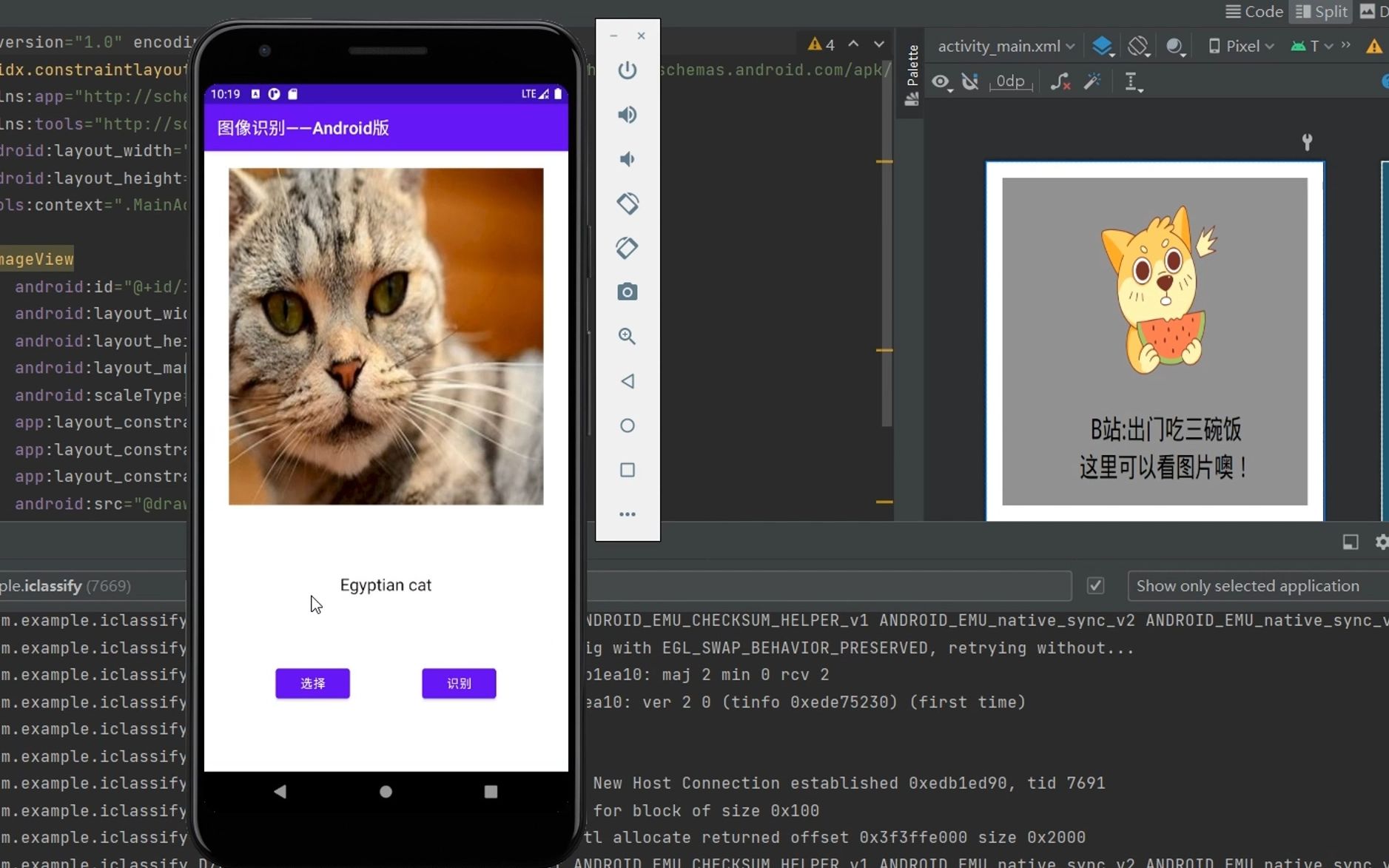

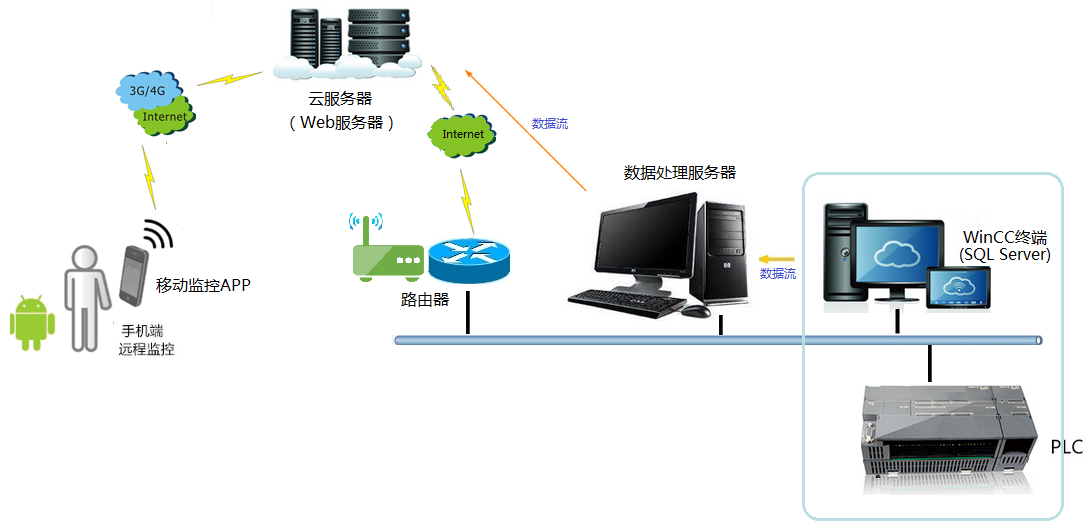

- 实时性要求:移动端部署需模型轻量化(如使用量化压缩技术)

- 多语言支持:中文手写体结构复杂,需更大规模数据集训练

BP神经网络的演进与替代方案

尽管传统BP神经网络在手写识别中表现良好(MNIST准确率约98%),但工业级应用更多采用改进模型:

- LeNet-5:Yann LeCun提出的卷积网络,首次应用于邮政手写邮编识别

- ResNet:残差网络解决深层网络梯度消失问题

- Transformer:基于自注意力机制,在复杂场景下展现潜力

权威数据与案例佐证

- MNIST数据集:包含6万训练样本和1万测试样本,被引用超7万次(Google Scholar数据)

- 实际应用:

- 中国邮政采用手写识别系统自动分拣邮件,效率提升40%

- 美国银行支票处理系统错误率低于0.01%(IEEE研究报告)

参考文献

- LeCun Y, Bottou L, Bengio Y, et al. Gradient-based learning applied to document recognition[J]. Proceedings of the IEEE, 1998.

- 邱锡鹏.《神经网络与深度学习》[M]. 机械工业出版社, 2020.

- MNIST官方数据库. http://yann.lecun.com/exdb/mnist/

通过理解BP神经网络的核心机制与优化方法,读者可进一步探索更复杂的模型设计,为实际工程问题提供可靠解决方案。