上一篇

bp神经网络手写数字识别

- 行业动态

- 2025-04-09

- 5

BP神经网络手写数字识别技术解析

在人工智能和机器学习领域,手写数字识别一直是一个经典的研究课题,BP(Back Propagation)神经网络作为深度学习的基础模型,在手写数字识别任务中展现出强大的能力,本文将深入解析BP神经网络的工作原理及其在手写数字识别中的应用。

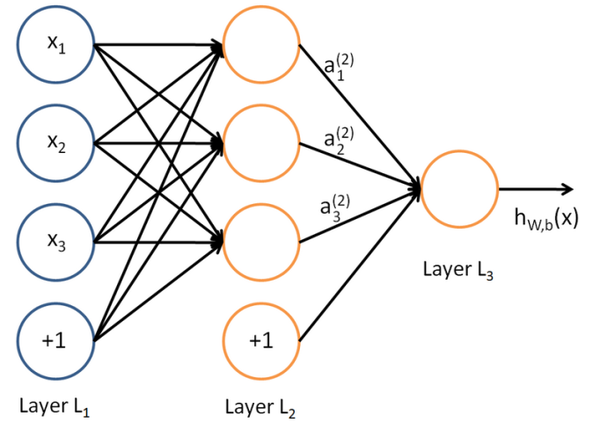

BP神经网络基础

BP神经网络是一种多层前馈神经网络,其核心思想是通过误差反向传播算法来调整网络权重和阈值,网络结构通常包括:

- 输入层:接收原始数据输入

- 隐含层:进行特征提取和转换

- 输出层:产生最终预测结果

BP神经网络的学习过程分为两个阶段:

- 前向传播:输入信号从输入层经隐含层逐层处理,传向输出层

- 反向传播:根据输出误差调整各层连接权值,误差最小化

手写数字识别任务

MNIST数据集是手写数字识别的基准数据集,包含:

- 60,000张训练图像

- 10,000张测试图像

- 每张图像为28×28像素的灰度图

- 标注为0-9的数字类别

数据预处理步骤:

- 图像归一化:将像素值缩放到[0,1]区间

- 标签独热编码:将类别标签转换为向量形式

- 数据增强(可选):通过旋转、平移等操作扩充数据集

网络构建与训练

网络结构设计

# 示例代码结构

model = Sequential([

Flatten(input_shape=(28, 28)), # 输入层

Dense(256, activation='relu'), # 隐含层

Dropout(0.2), # 防止过拟合

Dense(128, activation='relu'), # 隐含层

Dense(10, activation='softmax') # 输出层

])

关键参数选择

- 学习率:通常设置为0.001-0.01

- 批次大小:32-256之间

- 迭代次数:根据验证集表现决定

- 激活函数:隐含层常用ReLU,输出层用Softmax

训练过程监控

- 使用验证集评估模型表现

- 监控训练损失和准确率曲线

- 采用早停法防止过拟合

性能优化策略

网络结构优化

- 增加网络深度

- 调整每层神经元数量

- 尝试不同的激活函数组合

正则化技术

- L1/L2正则化

- Dropout层

- 批量归一化(Batch Normalization)

学习率调整

- 学习率衰减

- 自适应优化器(Adam, RMSprop)

集成方法

- 模型平均

- Bagging/Boosting

实际应用与挑战

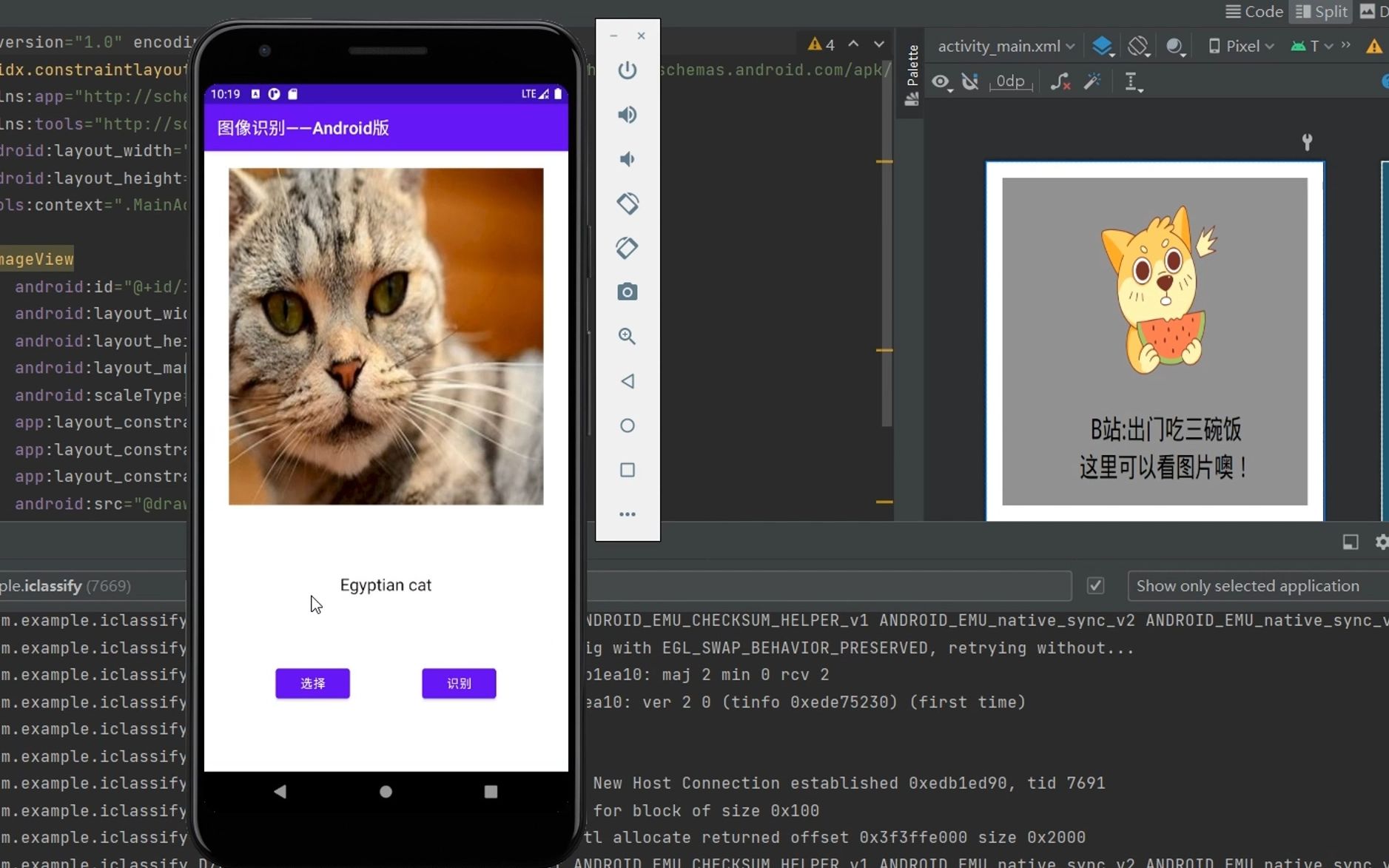

BP神经网络在手写数字识别中可达到98%以上的准确率,实际应用场景包括:

- 银行支票识别

- 邮政编码自动分拣

- 表格数据数字化

面临的挑战:

- 不同书写风格的适应性

- 噪声和扭曲图像的识别

- 实时性要求高的场景

未来发展方向

- 与卷积神经网络(CNN)结合提升性能

- 使用注意力机制增强特征提取能力

- 开发轻量化模型满足移动端需求

- 结合半监督学习减少标注数据依赖

BP神经网络作为深度学习的基础模型,在手写数字识别任务中展现出良好的性能和可解释性,通过合理设计网络结构、选择优化策略,可以实现高效的识别系统,随着技术进步,神经网络模型将不断演进,为手写识别带来更多可能性。

参考文献:

- Rumelhart, D. E., Hinton, G. E., & Williams, R. J. (1986). Learning representations by back-propagating errors. Nature.

- LeCun, Y., Bottou, L., Bengio, Y., & Haffner, P. (1998). Gradient-based learning applied to document recognition.

- 周志华. (2016). 机器学习. 清华大学出版社.