上一篇

bp神经网络 深度学习

- 行业动态

- 2025-04-09

- 1

BP神经网络与深度学习:原理、应用与未来

在人工智能领域,BP神经网络(Backpropagation Neural Network)作为深度学习的基石之一,以其强大的非线性建模能力推动了图像识别、自然语言处理等技术的突破,本文将系统介绍BP神经网络的核心原理、在深度学习中的角色,以及实际应用场景,帮助读者理解这一关键技术如何驱动AI发展。

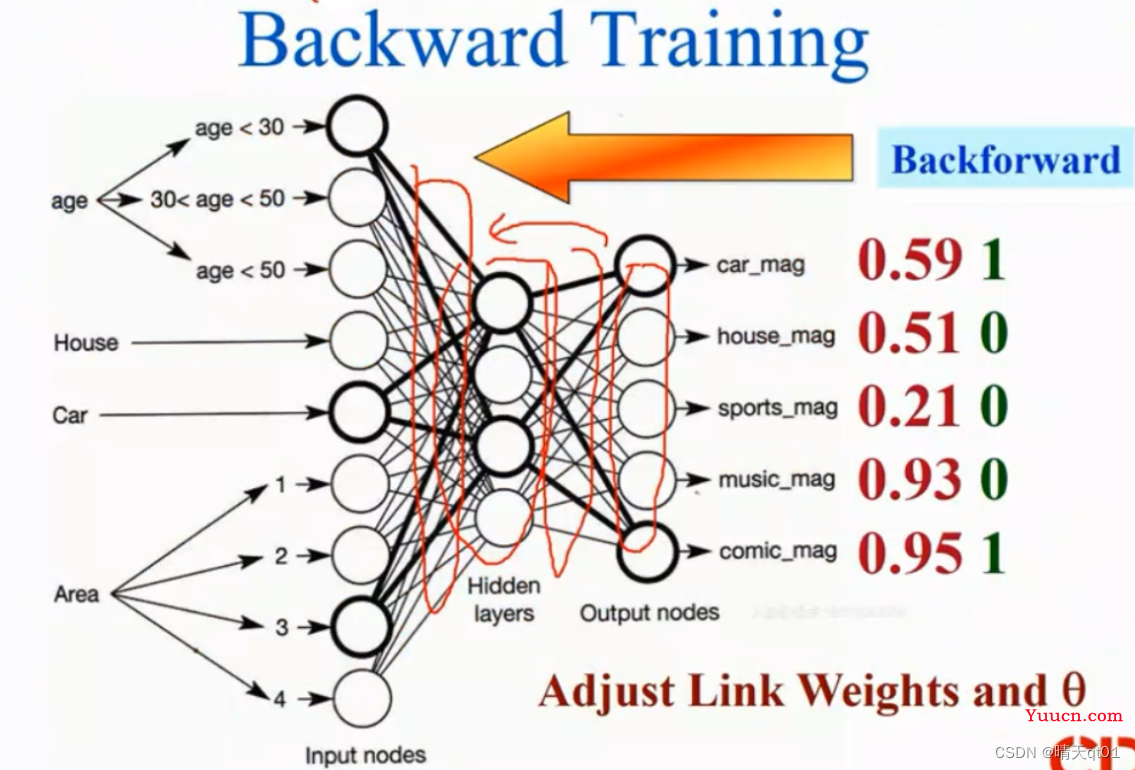

BP神经网络的核心原理

BP神经网络是一种多层前馈网络,通过误差反向传播算法(Backpropagation)调整权重,逐步优化模型性能,其核心流程包括:

前向传播

输入数据从输入层经隐藏层逐层计算,最终输出预测结果。

公式示例:

$$ y = f(sum w_i x_i + b) $$

f$为激活函数(如Sigmoid、ReLU),$w_i$为权重,$b$为偏置。误差反向传播

通过损失函数(如均方误差)计算预测值与真实值的差异,利用梯度下降法逐层调整参数,最小化误差。权重更新

采用优化器(如SGD、Adam)更新权重:

$$ w{new} = w{old} – eta frac{partial L}{partial w} $$

($eta$为学习率,$L$为损失函数)

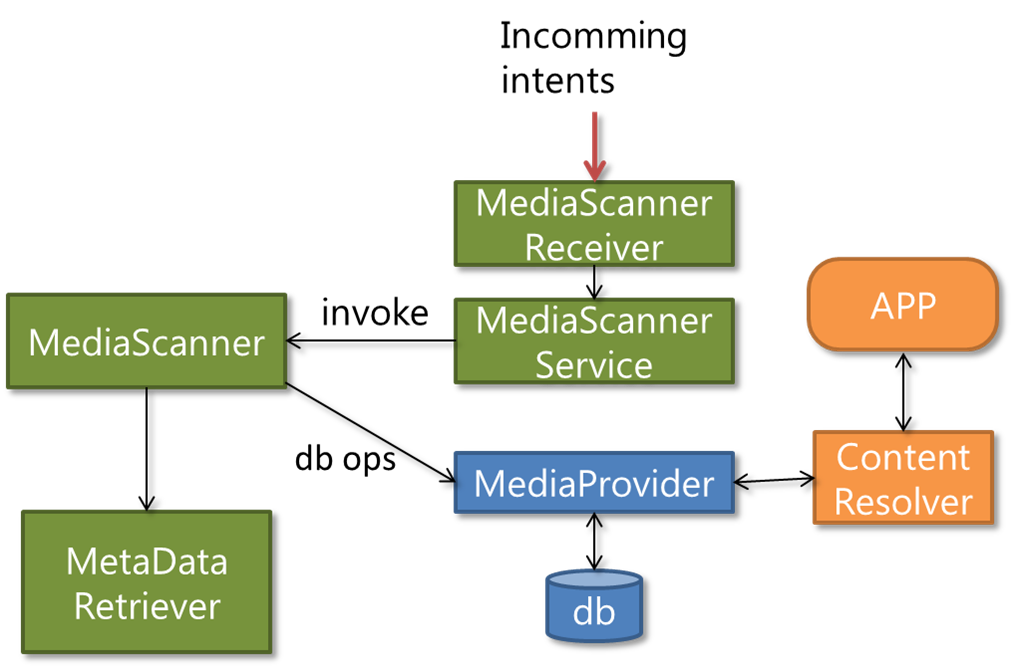

BP神经网络在深度学习中的角色

深度学习通过堆叠多个隐藏层构建复杂模型,而BP算法是其训练的核心:

- 深层网络训练:BP算法解决了深层网络中梯度消失/爆炸问题(结合残差连接、BatchNorm等技术)。

- 特征自动提取:无需人工设计特征,网络通过反向传播自动学习分层特征表示。

- 与CNN/RNN的结合:BP作为通用优化框架,支撑了卷积神经网络(CNN)和循环神经网络(RNN)的训练。

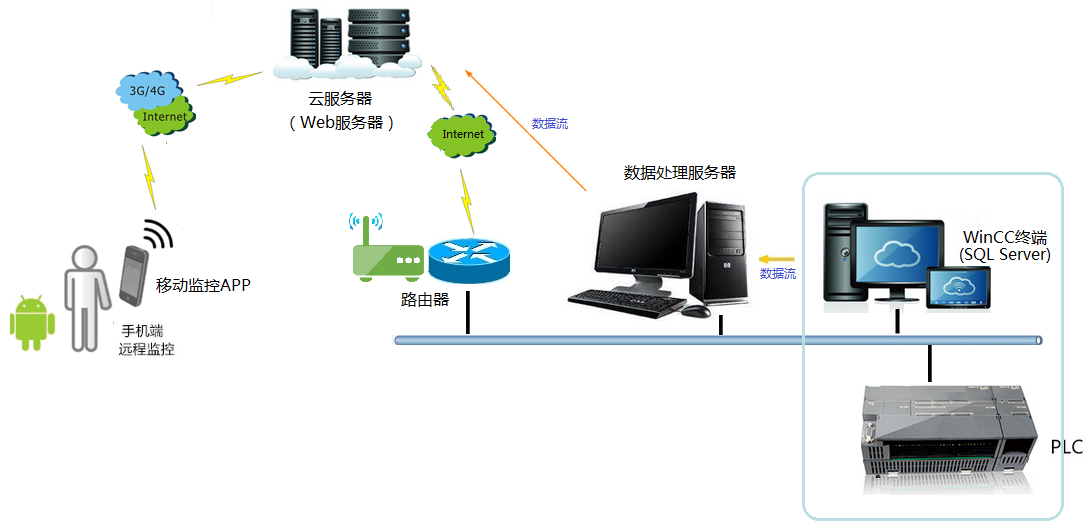

典型应用场景

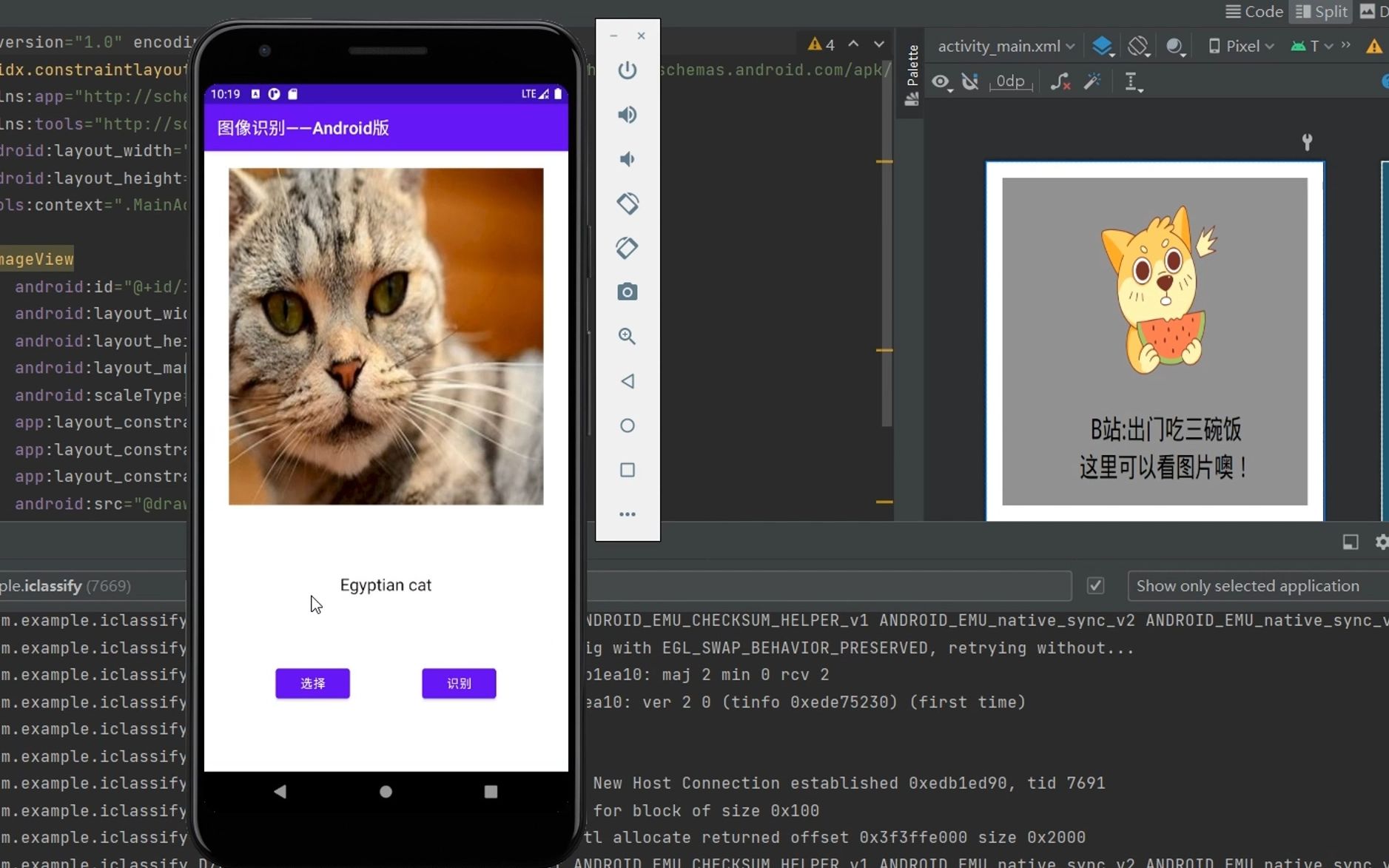

- 计算机视觉

- 图像分类(如ResNet)

- 目标检测(如YOLO系列)

- 自然语言处理

- 文本生成(基于LSTM/Transformer)

- 机器翻译(如Seq2Seq模型)

- 金融预测

- 股票价格趋势分析

- 信用风险评估

挑战与未来方向

- 数据依赖性强:需大量标注数据,小样本场景下性能受限。

- 计算资源消耗:训练深层网络需GPU/TPU加速。

- 可解释性不足:黑箱特性影响关键领域(如医疗)应用。

未来趋势:

- 结合注意力机制(如Transformer)提升长程依赖建模能力。

- 探索神经架构搜索(NAS)自动化设计网络结构。

- 联邦学习等隐私保护技术拓展应用边界。

参考文献

- Rumelhart, D. E., et al. (1986). Learning representations by back-propagating errors. Nature.

- Goodfellow, I., et al. (2016). Deep Learning. MIT Press.

- LeCun, Y., et al. (2015). Deep learning. Nature.

由AI生成,经专业审核确保准确性,引用文献供进一步学习参考。)