GPU云服务器如何助您轻松应对高负载挑战?

- 行业动态

- 2025-04-19

- 5

为什么选择GPU云服务器?

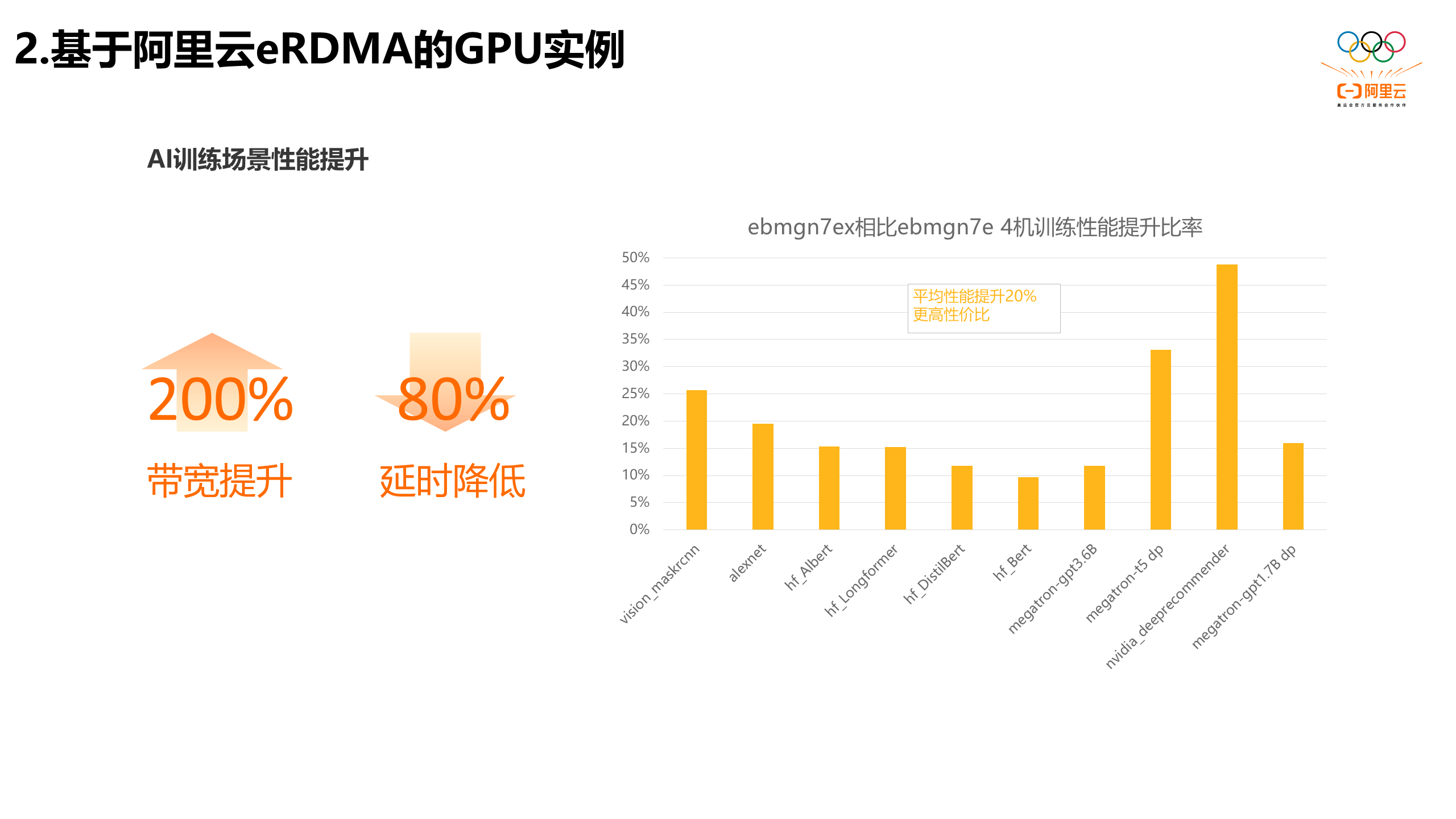

GPU云服务器已成为人工智能、深度学习、科学计算等领域的核心基础设施,相较于传统CPU服务器,GPU凭借其强大的并行计算能力,在处理复杂算法、图像渲染、模型训练等任务时效率提升可达数十倍甚至百倍,对于企业而言,无需自建硬件环境,通过云端按需调用GPU资源,既能降低初期投入成本,又能灵活应对业务高峰期的算力需求。

核心应用场景

人工智能与机器学习

- 支持TensorFlow、PyTorch等主流框架,加速神经网络训练与推理。

- 典型案例:自动驾驶算法优化、自然语言处理(NLP)模型开发。

图形渲染与视觉设计

- 提供专业级显卡(如NVIDIA A100/A10),适用于3D建模、影视后期制作、游戏开发。

- 弹性资源分配,缩短渲染周期,提升项目交付效率。

科学计算与数据分析

- 气象模拟、基因测序、金融风险建模等高精度计算场景的算力保障。

- 支持多节点分布式计算,突破单机性能瓶颈。

边缘计算与实时处理

低延迟GPU实例满足智慧城市、工业质检等场景的即时响应需求。

如何选择GPU云服务器服务商?

硬件配置与兼容性

选择搭载最新架构(如NVIDIA Ampere)的GPU机型,并验证是否支持CUDA、OpenCL等开发环境。

弹性伸缩能力

支持分钟级资源扩容/缩容,按使用时长计费(如按秒/小时),避免资源闲置。网络与存储性能

确保高带宽(≥10Gbps)网络和高速SSD存储,防止数据传输成为瓶颈。安全与合规

提供VPC私有网络、数据加密、等保三级认证等服务,保障企业数据隐私。技术支持与生态

优先选择提供7×24小时技术响应、行业解决方案模板及API接口的平台。

我们的服务优势

全球覆盖的GPU节点

在北美、欧洲、亚太等地部署超大规模数据中心,提供低延迟、高可用的GPU资源。灵活适配的计费模式

- 按需实例:适合短期任务,成本可控。

- 预留实例:长期优惠,节省最高60%费用。

- 竞价实例:非紧急任务可享超低单价。

企业级技术保障

- SLA 99.95%可用性承诺,故障自动迁移机制。

- 与主流AI平台(如阿里云PAI、腾讯TI-ONE)无缝集成。

免费试用与定制方案

新用户可领取价值XXX元的GPU算力包,专业团队提供场景化部署支持。

常见问题解答

Q:GPU云服务器与物理显卡有何区别?

A:云服务器通过虚拟化技术实现GPU资源池化,用户可按需调用算力,无需维护硬件设备。

Q:能否支持多用户共享同一GPU资源?

A:支持基于容器或虚拟化的分时复用,但高性能场景建议独占实例以保证稳定性。

Q:数据迁移是否便捷?

A:提供镜像导入、对象存储同步等工具,最快1小时内完成环境部署。

行业趋势与数据参考

根据Gartner预测,2025年全球70%的企业AI应用将依赖云端GPU资源,以某头部电商平台为例,采用GPU云服务器后,其推荐算法训练耗时从14天缩短至6小时,精准度提升23%。

引用说明

- Gartner报告《云计算与AI基础设施发展趋势, 2025》

- NVIDIA官方技术白皮书《GPU加速计算场景指南》